Visual-RFT: Visual Reinforcement Fine-Tuning

Abstract

OpenAI o1 같은 Large Reasoning Models에서의 Reinforcement Fine-Tuning (RFT)은 자신의 답변에 대한 feedback으로부터 학습하는 방식이며, 특히 fine-tuning data가 부족한 응용에서 매우 유용함.

DeepSeek-R1 같은 최근의 open-source 연구는, verifiable reward를 사용하는 reinforcement learning이 o1을 재현하는 데 있어 하나의 핵심 방향일 가능성이 있음을 보여줌.

R1-style model이 language models에서는 성공을 보여주었지만, multi-modal domain에의 적용은 아직 충분히 탐구되지 않았음.

이 문단 이해하려면 R1-style / reasoning tokens / verifiable reward / GRPO 이 4개를 정확히 잡아야 함.

1. R1-style model이 뭐냐?

한 줄 정의

→ “SFT 없이(or 최소화하고) RL + verifiable reward로 reasoning 능력을 키운 모델 스타일”

배경

기존 LLM 학습:

- Pretrain → SFT → RLHF

- 즉 정답 데이터 imitation 중심

근데 DeepSeek R1 에서는:

- SFT 거의 안 쓰고

- RL만으로 reasoning 능력 학습

핵심 특징 (R1-style)

- 여러 개 답 생성 (sampling)

- 정답 맞는지 rule로 검증 (verifiable reward)

- 잘한 답 쪽으로 policy 업데이트

즉,

👉 “정답을 외우는 게 아니라, 스스로 맞는 답을 찾도록 학습”

그래서 논문에서 말하는

R1-style model

은 그냥:

👉 DeepSeek R1 같은 RL 기반 reasoning 모델 방식 전체를 의미함

2. reasoning tokens / final answer

이건 R1 계열에서 엄청 중요한 구조임.

구조

모델 출력이 이렇게 나옴:

<think>

step1...

step2...

...

</think>

<answer>

final answer

</answer>

의미

1) reasoning tokens

→ <think> ... </think> 안에 있는 내용

- 모델의 생각 과정 (chain-of-thought)

- 중간 reasoning step

👉 쉽게:

"풀이 과정"

2) final answer

→ <answer> ... </answer>

- 최종 정답

👉 쉽게:

"답만"

왜 이렇게 나누냐?

RL에서:

- reasoning은 길게 자유롭게 생성

- reward는 final answer 기준으로만 평가

👉 핵심:

생각은 자유롭게, 평가는 정확하게

3. verifiable reward (visual perception용)

이게 이 논문의 핵심임.

일반 RLHF 문제

- reward model이 필요함

- 사람 preference 필요

- noisy / subjective

verifiable reward

→ 정답을 rule로 직접 검증하는 reward

예시

(1) classification

맞으면 1

틀리면 0

(2) detection

IoU 기반 점수

(3) grounding

bbox 겹치는 정도

이 논문에서 중요한 포인트

👉 이걸 visual task에도 적용함

그래서:

- language → 이미 가능

- vision → 이 논문이 확장

정리

👉 verifiable reward =

“정답인지 자동으로 체크 가능한 reward”

4. GRPO (Group Relative Policy Optimization)

이건 PPO 변형인데, 핵심만 보면 훨씬 쉬움.

기존 PPO 문제

- critic model 필요

- 학습 복잡

GRPO 아이디어

👉 답 여러 개 뽑아서 서로 비교

과정

- 하나의 input q

- 모델이 여러 답 생성

o1, o2, o3, ..., oG

- 각 답 reward 계산

r1, r2, r3, ..., rG

- 그룹 내에서 비교

Ai = (ri - mean) / std

👉 상대적으로 좋은 답 찾음

핵심 intuition

👉 "절대 점수" 말고

👉 "같은 문제 안에서 누가 더 잘했냐"만 봄

장점

- critic 필요 없음

- 안정적

- R1에서 핵심 역할

5. 이제 질문한 문장 다시 해석

원문:

Visual-RFT는 먼저 LVLM으로 reasoning tokens + final answer를 포함한 여러 response 생성 → verifiable reward → GRPO로 업데이트

풀어서 보면

Step 1. 여러 답 생성

input → 여러 개 답 생성

(각각 reasoning + final answer 포함)

Step 2. reward 계산

각 답에 대해:

- classification이면 맞는지

- detection이면 IoU

→ 점수 계산

Step 3. GRPO 업데이트

답들끼리 비교해서

잘한 답 쪽으로 모델 업데이트

한 줄로 정리

👉 이 논문 전체 핵심:

"vision task에서도

R1-style RL (reasoning + verifiable reward + GRPO)를 쓰자"

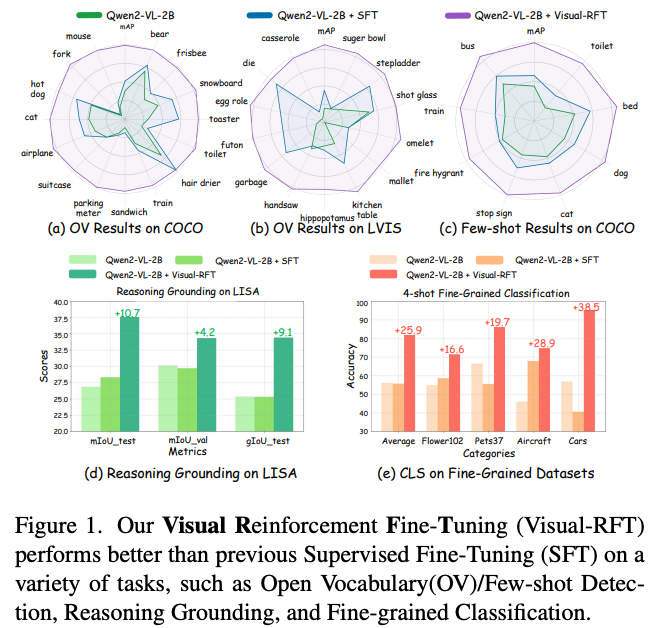

본 연구는 Visual Reinforcement Fine-Tuning (Visual-RFT)을 제안하며, 이를 통해 visual task로 RFT의 적용 영역을 한층 더 확장함.

구체적으로, Visual-RFT는 먼저 Large Vision-Language Models (LVLMs)를 사용해 각 입력에 대해 reasoning tokens와 final answer를 포함하는 여러 개의 response를 생성한 뒤, 우리가 제안하는 visual perception용 verifiable reward functions를 사용하여 Group Relative Policy Optimization (GRPO) 같은 policy optimization algorithm으로 모델을 업데이트함.

우리는 object detection에서의 Intersection over Union (IoU) reward와 같이, 서로 다른 perception task에 대해 서로 다른 verifiable reward functions를 설계함.

fine-grained image classification, few-shot object detection, reasoning grounding, 그리고 open-vocabulary object detection benchmark에서의 실험 결과는, Visual-RFT가 Supervised Fine-tuning (SFT)과 비교했을 때 경쟁력 있는 성능과 뛰어난 generalization 능력을 보여줌.

예를 들어, Visual-RFT는 약 100개의 sample만 사용하는 one-shot fine-grained image classification에서 baseline 대비 accuracy를 24.3% 향상시킴.

few-shot object detection에서도, Visual-RFT는 COCO의 4-shot setting에서 baseline보다 21.0, LVIS에서는 15.4 더 높은 성능을 기록함.

우리의 Visual-RFT는 LVLM fine-tuning의 paradigm shift를 보여주며, domain-specific task에 대한 reasoning과 adaptability를 강화하는 data-efficient하고 reward-driven한 접근법을 제공함.

2. Related Work

Large Vision Language Models (LVLMs) like GPT-4o [25]는 visual data와 textual data를 함께 통합함으로써 뛰어난 visual understanding 능력을 달성함.

이러한 통합은 complex multi-modal input을 이해하는 모델의 능력을 강화하고, 이미지와 텍스트를 모두 처리하고 응답할 수 있는 더 advanced한 AI systems [15, 18, 40, 52]를 가능하게 함.

일반적으로 LVLMs의 training은 두 단계로 이루어짐: (a) pre-training과 (b) supervised fine-tuning 및 reinforcement learning을 포함하는 post-training임.

Post-training은 모델의 response quality, instruction following, reasoning ability를 향상시키는 데 핵심적임.

post-training 단계에서 reinforcement learning을 사용해 LLM을 강화하는 연구 [1, 3, 27, 30, 34, 35, 38, 44, 48, 62, 63]는 상당히 많이 진행되어 왔지만, LVLMs에서의 진전은 더 느렸음.

본 논문에서는 post-training 단계에서 GRPO-based reinforcement algorithm과 verifiable reward를 사용해 모델의 visual perception과 reasoning capability를 강화하는 Visual-RFT를 제안함.

Reinforcement Learning

최근 OpenAI o1 [7]과 같은 reasoning model이 등장하면서, Large Language Models (LLMs) 연구의 초점은 reinforcement learning (RL) 기법을 통해 모델의 reasoning capability를 강화하는 방향으로 점점 이동해 왔음.

여러 연구는 수학 문제 풀이 [2, 22, 33, 43, 45] 및 coding [6, 8, 51, 54]과 같은 reasoning task에서 LLM의 성능을 향상시키는 방안을 탐구해 왔음.

이 분야의 대표적 breakthrough 중 하나는 DeepSeek-R1-Zero [4]이며, 이는 supervised fine-tuning (SFT) 단계를 제거하고 오직 RL만 사용해 robust한 reasoning capability를 달성하는 새로운 접근을 제시함.

하지만 현재 RL-based reasoning에 대한 연구는 대체로 language domain에 국한되어 있으며, multi-modal setting으로의 적용은 제한적으로만 탐구되었음.

LVLMs에서 RL은 주로 hallucination 완화와 human preference alignment [21, 36, 37, 46, 47, 55, 60, 61] 같은 task에 사용되어 왔지만, Large Vision Language Models의 reasoning과 visual perception을 강화하는 데 초점을 맞춘 연구는 여전히 큰 공백이 있음.

이 공백을 메우기 위해, 본 연구는 GRPO-based [33] RL과 verifiable reward를 폭넓은 visual perception task에 적용하는 새로운 reinforcement fine-tuning 전략 Visual-RFT를 도입함.

우리의 접근은 특히 fine-tuning data가 제한적일 때, 다양한 visual task를 처리하는 LVLMs의 성능을 향상시키는 것을 목표로 함.

3. Methodology

3.1. Preliminary

Reinforcement Learning with Verifiable Rewards.

Reinforcement Learning with Verifiable Rewards (RLVR) [4, 14, 39]는 수학과 coding처럼 결과를 객관적으로 검증할 수 있는 task에서 language model을 강화하도록 설계된 새로운 training approach임.

학습된 reward model에 의존하는 기존 Reinforcement Learning from Human Feedback (RLHF) [19, 28, 49]와 달리, RLVR은 correctness를 평가하기 위해 direct verification function을 사용함.

1. RLHF (기존 방식)

구조

모델 출력 → reward model → 점수

어떻게 동작하냐면

- 사람이 "이 답이 더 좋다" 같은 선호 데이터 만듦

- 그걸로 reward model 학습

- 모델이 답 생성하면 → reward model이 점수 매김

문제

- reward model이 완벽하지 않음

- subjective함 (사람 취향)

- hallucination 가능

👉 즉:

"정답인지"가 아니라 "좋아 보이는지" 평가함

2. RLVR (이 논문 방식)

구조

모델 출력 → 정답 비교 → 점수

어떻게 하냐면

- 그냥 정답이 맞는지 직접 확인

예시

(1) classification

정답 = cat

예측 = cat → reward = 1

예측 = dog → reward = 0

(2) detection

IoU 계산 → 값이 높으면 reward ↑

(3) 수학 문제

정답 = 42

예측 = 42 → reward = 1

핵심

👉 사람이나 모델 필요 없음

👉 그냥 "맞았냐?"만 보면 됨

3. 핵심 차이 한 줄

방식어떻게 평가함| RLHF | learned reward model |

| RLVR | 정답 직접 비교 (rule-based) |

4. 직관적으로 이해

RLHF

👉 "이 답 괜찮은 것 같아"

(느낌 기반)

RLVR

👉 "정답 맞았냐?"

(정확성 기반)

5. 왜 중요한가 (논문 핵심)

이 논문 포인트는 이거임:

👉 이걸 vision에도 가져옴

예:

- detection → IoU

- classification → accuracy

- grounding → bbox overlap

🔥 한 줄 정리

👉 RLHF:

"좋아 보이면 보상"

👉 RLVR:

"정답이면 보상"

verifiable reward ?

“정답이 맞는지 자동으로 검증 가능한 reward”

1. 왜 필요하냐?

기존 RLHF:

모델 출력 → reward model → 점수

문제:

- 사람 데이터 필요

- subjective (취향)

- noisy

2. verifiable reward 방식

모델 출력 → 정답 비교 → 점수

👉 사람 필요 없음

👉 모델도 필요 없음

👉 그냥 rule로 판단

3. 가장 쉬운 예시

(1) classification

정답 = cat

예측 = cat → reward = 1

예측 = dog → reward = 0

(2) 수학 문제

2+2 = ?

예측 = 4 → reward = 1

예측 = 5 → reward = 0

(3) object detection

IoU = 0.8 → reward 높음

IoU = 0.1 → reward 낮음

4. 수식으로 보면

논문 기준:

\(

R(q, o) =

\begin{cases}

1 & \text{if correct} \\

0 & \text{otherwise}

\end{cases}

\)

5. 핵심 특징

✅ 자동 평가 가능

→ 사람이 안 봐도 됨

✅ objective

→ 정답 기준이라 정확함

✅ RL에 최적

→ reward noise 없음

6. 이 논문에서 중요한 이유

원래:

👉 RLVR = math / coding에서만 가능

이 논문:

👉 vision에서도 가능하게 만듦

예

- classification → 정답 비교

- detection → IoU

- grounding → bbox overlap

👉 이걸 전부 verifiable reward로 정의

이 접근은 reward mechanism을 단순화하면서도, task 고유의 correctness criterion과의 강한 alignment를 유지함.

입력 질문 \(q\)가 주어지면, policy model \( \pi_{\theta} \)는 response \(o\)를 생성하고 verifiable reward를 받음.

더 구체적으로, RLVR은 다음 objective를 최적화함:

\( \max_{\pi_{\theta}} \mathbb{E}_{o \sim \pi_{\theta}(q)} [R_{\mathrm{RLVR}}(q, o)] \) (1)

\( = [R(q, o) - \beta \,\mathrm{KL}[\pi_{\theta}(o|q) \,\|\, \pi_{\mathrm{ref}}(o|q)]] \) (2)

여기서 \( \pi_{\mathrm{ref}} \)는 optimization 이전의 reference model이고, \(R\)은 verifiable reward function이며, \( \beta \)는 KL-divergence를 제어하는 hyper-parameter임.

Verifiable reward function \(R\)는 question-output pair \( (q, o) \)를 입력으로 받아, ground-truth answer가 prediction \(o\)와 같은지를 확인함:

\( R(q, o) =

\begin{cases}

1, & \text{if } o = \text{ground truth}, \\

0, & \text{otherwise.}

\end{cases} \) (3)

DeepSeek R1-Zero and GRPO.

DeepSeek R1-Zero algorithm은 training에 reinforcement learning을 사용함으로써 supervised fine-tuning (SFT)에 대한 의존을 제거하며, 구체적으로는 Group Relative Policy Optimization (GRPO) framework를 사용함.

policy performance를 평가하기 위해 critic model이 필요한 PPO [32] 같은 reinforcement learning algorithm과 달리, GRPO는 candidate response들의 그룹을 직접 비교하므로 추가적인 critic model이 필요 없음.

PPO는 critic model이 필요하지만

GRPO는 response 그룹끼리 비교해서 critic이 필요 없음

2. PPO에서 critic model이 왜 필요함?

PPO 구조를 보면:

- policy: 답을 생성하는 모델

- critic: 그 답이 얼마나 좋은지 평가하는 모델

흐름

input → policy → 답 생성 → critic → 점수

critic의 역할:

"이 답이 얼마나 좋은가?"

즉, value function ( V(s) ) 추정

문제

- critic 따로 학습해야 함

- 불안정함

- bias 생길 수 있음

- 구현 복잡

3. GRPO는 어떻게 다름?

핵심 아이디어:

"절대적으로 평가하지 말고, 서로 비교하자"

흐름

하나의 input q에 대해

Step 1: 여러 답 생성

o1, o2, o3, ..., oG

Step 2: reward 계산

r1, r2, r3, ..., rG

(이 논문에서는 IoU, accuracy 같은 verifiable reward)

Step 3: 상대 비교

\( A_i = \frac{r_i - \text{mean}(r)}{\text{std}(r)} \)

의미

- 평균보다 잘하면 positive

- 평균보다 못하면 negative

4. 왜 critic이 필요 없어짐?

PPO:

"이 답이 좋은지" → critic이 판단

GRPO:

"이 답이 다른 답보다 좋은지" → 비교로 판단

핵심 차이

| PPO | 절대 점수 (critic 필요) |

| GRPO | 상대 순위 (critic 필요 없음) |

5. 직관적인 예

같은 문제에서 3개 답이 나왔다고 하자

o1 → reward 0.9

o2 → reward 0.6

o3 → reward 0.2

GRPO는 이렇게 생각함:

- o1: 제일 좋음 → 강화

- o2: 중간 → 약하게

- o3: 나쁨 → 억제

여기서 중요한 점:

→ "얼마나 좋은지" 몰라도 됨

→ "누가 더 좋은지"만 알면 됨

6. 왜 이게 중요한가

장점

- critic 필요 없음 → 구조 단순

- 학습 안정적

- reward model 필요 없음 (verifiable reward와 잘 맞음)

7. 이 논문에서의 의미

이 논문 구조는:

여러 response 생성 → IoU / accuracy reward 계산 → GRPO로 비교 → 업데이트

즉,

- critic 없음

- reward model 없음

- rule-based reward만 사용

8. 한 줄 정리

PPO: "이 답이 얼마나 좋은지 맞춰야 함"

GRPO: "이 답이 다른 답보다 좋은지만 보면 됨"

주어진 질문 \(q\)에 대해, GRPO는 먼저 현재 policy \( \pi_{\theta_{\mathrm{old}}} \)로부터 \(G\)개의 distinct response \( \{o_1, o_2, ..., o_G\} \)를 생성함.

이후 GRPO는 이러한 response에 기반해 action을 취하고, 얻어진 reward를 \( \{r_1, r_2, ..., r_G\} \)로 둠.

normalization을 위해 이들의 mean과 standard deviation을 계산함으로써, GRPO는 이 response들의 relative quality를 다음과 같이 결정함:

normalization을 위해 mean과 standard deviation을 계산해서,

각 response의 상대적인 quality를 정한다

무슨 의미냐?

여러 개 답이 있을 때:

- 그냥 reward 값 그대로 쓰는 게 아니라

- 평균 기준으로 “얼마나 잘했는지”를 계산함

예로 보면

답 3개:

- r1 = 0.9

- r2 = 0.6

- r3 = 0.2

평균 ≈ 0.57

이렇게 바뀜

- r1 → 평균보다 훨씬 좋음 → 높은 점수

- r2 → 평균보다 조금 좋음 → 약간 긍정

- r3 → 평균보다 나쁨 → 음수

왜 이렇게 하냐?

핵심 이유 2개:

1. scale 문제 제거

- 어떤 문제는 reward가 다 높고

- 어떤 문제는 다 낮을 수 있음

→ 비교가 어려움

2. 상대 비교만 하기 위해

GRPO는 절대 점수 안 봄

→ 같은 문제 안에서 누가 더 잘했는지만 봄

한 줄 요약

→ "평균 기준으로 잘했는지 못했는지로 점수를 바꾼다"

더 직관적으로

- 평균보다 잘함 → 강화

- 평균보다 못함 → 억제

진짜 핵심

이 한 줄이 의미하는 건:

→ GRPO는

절대 reward가 아니라 상대 ranking으로 학습한다는 것

\( A_i = \frac{r_i - \mathrm{mean}(\{r_1, \ldots, r_G\})}{\mathrm{std}(\{r_1, \ldots, r_G\})} \) (4)

여기서 \(A_i\)는 \(i\)번째 answer의 relative quality를 나타냄.

GRPO는 그룹 내에서 reward 값이 높은 더 나은 answer를 선호하도록 모델을 유도함.

3.2. Visual-RFT

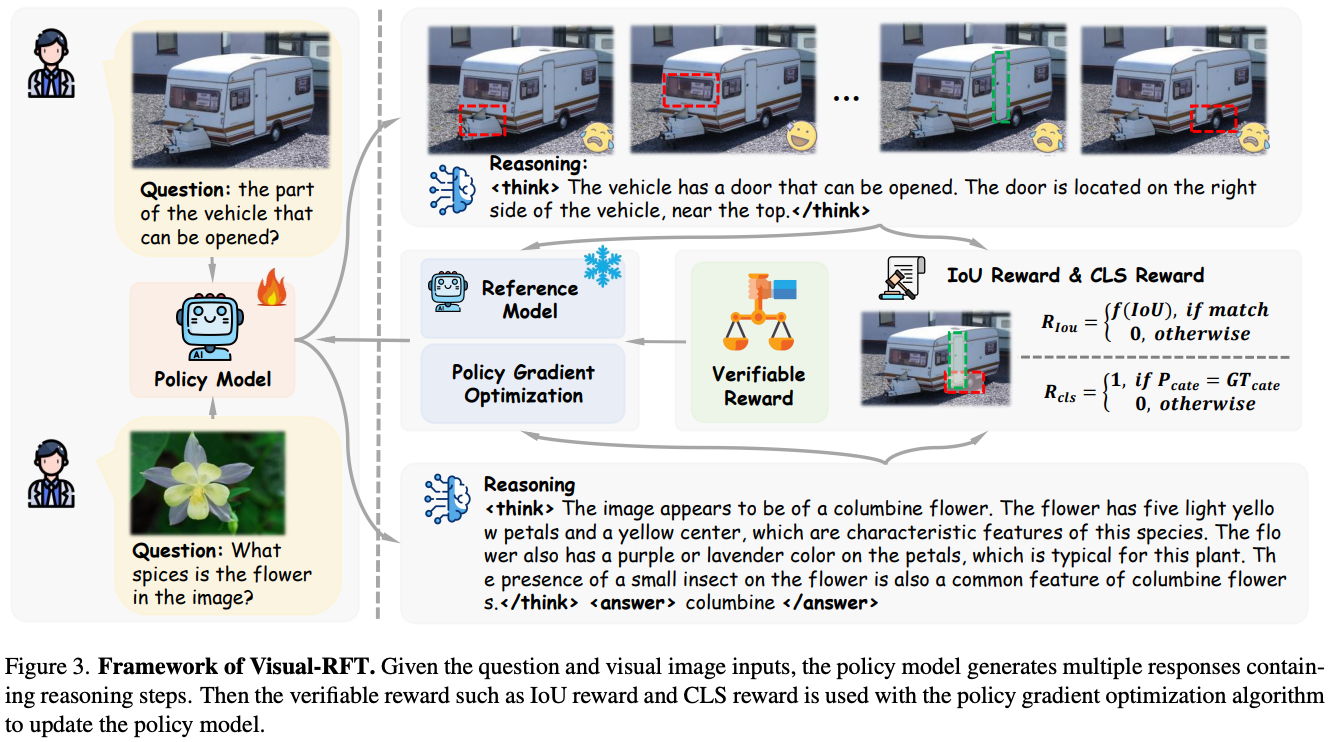

Visual-RFT의 framework는 Fig. 3에 제시되어 있음.

사용자로부터의 multi-modal input data는 이미지와 질문으로 구성됨.

policy model \( \pi_{\theta} \)는 reasoning process를 출력하고, 입력에 기반한 response group을 생성함.

각 response는 reward를 계산하기 위해 verifiable reward function을 통과함.

각 output에 대한 reward의 group-wise computation 이후, 각 response의 quality가 평가되고 policy model 업데이트에 사용됨.

policy model training의 안정성을 보장하기 위해, Visual-RFT는 policy model과 reference model 사이의 차이를 제한하는 KL divergence를 사용함.

visual task용 verifiable reward를 어떻게 설계하는지는 Sec. 3.2.1에서, data preparation 단계는 Sec. 3.2.2에서 추가로 논의함.

3.2.1. Verifiable Reward in Visual Perception

reward model은 reinforcement learning (RL)에서 모델을 preference alignment algorithm과 정렬시키는 핵심 단계이며, prediction과 ground-truth answer가 정확히 일치하는지를 확인하는 verification function처럼 비교적 단순한 형태일 수도 있음.

최근 DeepSeek-R1 [4] 모델의 RL training process는 verifiable reward design을 통해 모델의 reasoning ability를 크게 향상시킴.

이 전략을 visual domain으로 확장하기 위해, 우리는 다양한 visual perception task에 맞는 서로 다른 rule based verifiable reward function을 설계함.

IoU Reward in Detection Tasks.

detection task에서 모델의 output은 bounding box (bbox)와 그에 대응하는 confidence로 구성됨.

detection task의 reward function은 evaluation에서 mean Average Precision (mAP)을 계산하는 데 사용되는 Intersection-over-Union (IoU) metric을 충분히 고려해야 함.

따라서 우리는 IoU와 confidence 기반의 reward function \(R_d\)를 설계함.

먼저, 모델의 output box와 confidence에 대해, 이 box들을 confidence 기준으로 정렬하고 이를 \( \{b_1, b_2, ..., b_n\} \)으로 표기함.

그런 다음 각 \(b_i\)를 ground-truth bbox \( \{b^g_1, b^g_2, ..., b^g_m\} \)와 매칭하고, IoU threshold \( \tau \)를 설정한 상태에서 IoU를 계산함.

이 threshold \( \tau \)보다 낮은 IoU를 가지는 bounding box는 invalid로 간주되며, 매칭되지 않은 bbox의 IoU는 0이 됨.

매칭 이후, 초기 집합의 각 box에 대해 IoU와 confidence를 얻으며, 이를 \( \{iou_1 : c_1, iou_2 : c_2, ..., iou_n : c_n\} \)으로 표기함.

이후 이러한 IoU 결과와 confidence를 사용해 reward \(R_d\)를 구성함.

우리의 reward \(R_d\)는 IoU reward, Confidence reward, Format reward의 세 부분으로 구성됨:

\( R_d = R_{\mathrm{IoU}} + R_{\mathrm{conf}} + R_{\mathrm{format}} \) (5)

IoU reward \(R_{\mathrm{IoU}}\)는 모델 output에 포함된 모든 bounding box의 평균 IoU임.

\( R_{\mathrm{IoU}} = \frac{iou_1 + iou_2 + \cdots + iou_n}{n} \) (6)

confidence reward \(R_{\mathrm{conf}}\)는 IoU와 관련됨.

각 bounding box에 대해, \(iou_i\)가 0이 아니면 이는 successful match를 의미하며, 이 단일 box에 대한 confidence reward \(r_{c_i}\)는 예측 confidence를 사용해 다음과 같이 계산됨:

\( r_{c_i} =

\begin{cases}

c_i, & \text{if } iou_i \neq 0, \\

1 - c_i, & \text{if } iou_i = 0.

\end{cases} \) (7)

이는 successful하게 매칭된 box일수록 confidence가 높을수록 더 좋다는 의미임.

\(iou_i\)가 0이면 failed match를 뜻하며, 이 경우 해당 box에 대해서는 confidence가 낮을수록 더 좋음.

모델 output 전체의 confidence reward \(R_{\mathrm{conf}}\)는 그 output에 포함된 모든 bounding box의 confidence reward 평균임.

\( R_{\mathrm{conf}} = \frac{\sum_{i=1}^{n} r_{c_i}}{n} \) (8)

format reward \(R_{\mathrm{format}}\)는 모델 prediction이 `<think>`와 `<answer>`의 required HTML tag format을 따르도록 강제하는 데 사용됨 (자세한 내용은 Sec. 3.2.2에서 설명함).

CLS Reward in Classification Tasks.

classification task에서 우리가 사용하는 reward function은 accuracy reward \(R_{\mathrm{acc}}\)와 format reward \(R_{\mathrm{format}}\)의 두 부분으로 구성됨.

accuracy reward는 모델의 output class를 ground-truth class와 비교해 결정되며, 분류가 correct이면 1, incorrect이면 0의 값을 가짐:

\( R_{\mathrm{cls}} = R_{\mathrm{acc}} + R_{\mathrm{format}} \) (9)

3.2.2. Data Preparation

다양한 visual perception task에서 Visual-RFT를 학습시키기 위해서는 multi-modal training dataset을 구성해야 함.

DeepSeek-R1과 유사하게, 모델의 reasoning ability를 강화하고 이 능력을 visual perception 개선에 활용하기 위해, Visual-RFT는 모델이 final answer를 제시하기 전에 reasoning process를 먼저 출력하도록 유도하는 prompt format을 설계함.

detection task와 classification task에 사용된 prompt는 Tab. 1에 제시되어 있음.

training 과정에서 우리는 format reward를 사용해 모델이 reasoning process와 final answer를 structured format으로 출력하도록 유도함.

reasoning process는 reinforcement fine-tuning 동안 모델의 self-learning과 improvement에 핵심적이며, answer로 결정되는 reward는 모델의 optimization 방향을 이끔.

4. Experiments

4.1. Experimental Setup

Implementation Details

우리 방법은 다양한 visual perception task에 유연하게 적용 가능함.

우리는 모델에 극소수의 sample만 제공하는 few-shot learning 접근을 사용해 학습을 수행함.

image classification과 object detection task에서는, 제한된 data에 reinforcement learning을 적용하여 모델의 fine-grained discrimination 및 recognition capability를 평가하기 위해 few-shot setting을 채택함.

그다음, 강한 reasoning ability를 요구하는 reasoning grounding 중심의 LISA [13] dataset에서는, Visual-RFT로 모델을 학습시키고 reasoning 및 perception 성능을 평가함.

마지막으로, open-vocabulary object detection에서는 48개의 base class를 포함하도록 분할한 COCO dataset에서 Qwen2-VL-2/7B [40]를 Visual-RFT로 학습시켜 모델의 generalization capability를 평가함.

그 후 COCO의 17개 novel class와 LVIS [5]의 13개 rare class에서 테스트를 수행함.

모델의 visual perception과 reasoning ability는 open-vocabulary detection setting에서 평가됨.

우리의 detection experiment에서는 먼저 category가 이미지 안에 존재하는지 모델에 prompt하고, 그다음 이미지에 실제로 존재하는 category에 대해 bounding box를 예측하게 함.

4.2. Few-Shot Classification

visual domain에서 Visual-RFT의 폭넓은 generalization ability를 보여주기 위해, 우리는 fine-grained image classification에 대한 few-shot experiment를 수행함.

여기서 fine-grained는 AI/vision에서 자주 쓰는 용어라 정확히 짚고 가는 게 좋음.

👉 fine-grained = “비슷한 것들끼리 아주 세밀하게 구분하는 것”

1. 직관적인 예

일반 classification (coarse-grained)

- dog vs cat

- car vs airplane

👉 차이가 큼 → 쉬움

fine-grained classification

- Labrador vs Golden Retriever

- Boeing 737 vs Airbus A320

- BMW 3-series vs BMW 5-series

👉 거의 비슷함 → 어려움

2. 왜 어려운가

- 색, 질감, 작은 구조 차이만 존재

- global feature로는 구분 안 됨

- 디테일 (fine detail) 필요

3. 논문 문장에서 의미

fine-grained image classification

👉

"비슷한 클래스들 사이에서 아주 미세한 차이를 구분하는 classification"

4. 문장 다시 해석

visual domain에서 Visual-RFT의 generalization을 보여주기 위해

fine-grained classification 실험을 했다

👉 의미:

- 쉬운 task 말고

- 어려운 구분 문제에서도 잘 되는지 테스트했다

5. 왜 여기서 중요함

fine-grained task는:

- 단순 pattern matching으로 안 됨

- reasoning + detail understanding 필요

👉 그래서 이 논문 주장과 연결됨:

- Visual-RFT → reasoning 기반 학습

- → 더 미세한 차이도 잘 잡음

우리는 Flower102 [24], Pets37 [29], FGVCAircraft [23], Car196 [12]의 네 개 dataset을 선택했으며, 이 dataset들은 수십 개에서 수백 개에 이르는 유사한 category를 포함하고 있어 classification task의 난도를 크게 높임.

Tab. 2에서 보이듯, 단 1-shot data만으로도 Visual-RFT는 이미 유의미한 성능 향상(+24.3%)을 보여줌.

반면 SFT는 동일하게 극소량의 data를 사용했을 때 눈에 띄는 성능 하락(-4.3%)을 보임.

4-shot setting에서는 SFT의 성능이 여전히 baseline보다 약간 낮은 반면, Visual-RFT로 reinforcement fine-tuning된 모델은 평균적으로 25.9의 성능 향상을 달성함.

8-shot setting에서는 data 양이 증가함에 따라 SFT 성능이 baseline을 소폭 상회함.

하지만 SFT는 여전히 Visual-RFT의 성능에 비해 크게 뒤처짐.

Fig. 4에서는 fine-grained classification task를 처리할 때 reinforcement fine-tuning 이후 모델의 inference case 일부를 제시함.

이 결과는 Visual-RFT의 강한 generalization ability와 제한된 data로부터 학습하는 능력을 보여줄 뿐 아니라, SFT와 비교했을 때 reinforcement fine-tuning이 task에 대한 진정한 이해와 reasoning을 통한 더 깊은 학습으로 이어짐을 확인시켜 줌.

더 많은 shot setting에서의 추가 결과와, 7B 모델의 성능 및 out-of-domain dataset 결과는 Sec. D.2와 Sec. C에 제시함.

4.3. Few-Shot Object Detection

few-shot learning은 traditional visual model과 large-scale vision-language model (LVLM) 모두가 늘 직면해 온 핵심 과제 중 하나였음.

reinforcement fine-tuning은 적은 양의 data만으로도 모델이 빠르게 학습하고 이해할 수 있게 함으로써, 이 문제에 대한 새로운 해법을 제공함.

우리는 COCO dataset에서 8개 category를 선택하고, 각 category마다 1장, 4장, 8장의 이미지를 사용해 제한된 data 기반 training set을 구성함.

LVIS dataset에서는 6개의 rare category를 선택함.

이 rare category들의 training image는 매우 희소하여 각 category당 1장부터 10장 사이의 이미지만 존재하므로, 우리는 이를 10-shot setting으로 근사함.

그 후 limited data에서의 학습 능력을 평가하기 위해, reinforcement fine-tuning과 SFT를 모두 사용하여 Qwen2-VL-2/7B 모델을 200 step 동안 학습시킴.

Tab. 3과 Tab. 4에서 보이듯, SFT와 reinforcement fine-tuning 모두 few-shot setting에서 모델의 recognition accuracy를 향상시킬 수 있지만, reinforcement fine-tuning 이후의 모델은 항상 큰 폭으로 SFT 모델을 능가하며 유의미한 격차를 유지함.

COCO [17] category에서는 training data가 늘어남에 따라 SFT 모델의 평균 mAP가 약 30에 도달하는 반면, reinforcement fine-tuning된 모델은 47에 근접함.

Tab. 4에 제시된 LVIS [5] few-shot experiment 결과에서도, LVIS의 더 도전적인 6개 rare category에 대해 reinforcement fine-tuning은 여전히 SFT를 능가함.

Tab. 3과 Tab. 4의 결과는 few-shot setting에서 reinforcement fine-tuning이 보여주는 탁월한 성능을 분명히 보여주며, 모델이 소량의 data만으로도 reinforcement learning을 통해 visual perception capability를 크게 향상시킴을 나타냄.

더 많은 shot setting에서의 추가 결과와 7B 모델의 결과는 Sec. D.3에 제시하였고, domain-specific detection dataset에 대한 결과는 Sec. C에 함께 제시함.

4.4. Reasoning Grounding

vision-language intelligence의 또 다른 핵심 측면은 사용자 요구에 따라 정확한 object를 grounding하는 것임.

기존의 specialized detection system은 reasoning ability가 부족해 사용자의 의도를 충분히 이해하지 못함.

👉 grounding = “말(텍스트)이 가리키는 대상을 이미지에서 정확히 찾는 것”

2. 직관적인 예

입력

"왼쪽에 있는 빨간 모자를 쓴 사람을 찾아라"

모델이 해야 할 일

- 사람 여러 명 있음

- 그 중에서

- “왼쪽”

- “빨간 모자”

조건을 만족하는 딱 한 명 찾기

👉 그 위치를 bounding box로 출력

3. 그냥 detection이랑 뭐가 다름?

(1) 일반 object detection

이미지 → 모든 객체 찾기

예:

- 사람 3명

- 자동차 2개

👉 그냥 다 찾음

(2) grounding

이미지 + 텍스트 → 특정 객체 하나 찾기

예:

- “빨간 옷 입은 사람”

- “문 옆에 있는 개”

👉 텍스트 조건을 이해해야 함

4. 논문 문장 다시 해석

원문

사용자 요구에 따라 정확한 object를 grounding

👉 의미:

"사용자가 말로 설명한 대상 하나를

이미지에서 정확히 찾아내는 것"

다음 문장

기존 detection system은 reasoning이 부족해서 의도를 이해 못함

👉 의미:

- 기존 모델은:

- 그냥 "object"만 찾음

- "조건" 이해 못함

5. 왜 reasoning이 필요함?

예:

"책상 위에 있는 컵 중에서 가장 큰 것"

이걸 하려면:

- 컵 찾고

- 위치 확인하고

- 크기 비교해야 함

👉 단순 detection으로 못함

👉 reasoning 필요

6. 논문이 말하는 핵심

기존 모델:

"이건 컵이다"

Visual-RFT:

"컵 여러 개 중에서 조건에 맞는 걸 선택"

👉 즉:

perception + reasoning 결합

LISA [13]가 이 방향을 개척한 이후, large language model (LLM)이 다른 모델(예: SAM [11])을 위한 control token을 출력하거나, supervised fine-tuning을 통해 bounding box coordinate를 직접 예측하도록 하는 연구 [31, 40]가 진행되어 왔음.

본 연구에서는 이 task에 Visual-RFT를 사용하는 방식을 탐구했고, reinforcement learning (RL)이 supervised fine-tuning보다 유의미한 개선을 가져온다는 점을 확인함.

우리는 reasoning grounding object를 포함하는 239장의 이미지로 구성된 LISA training set에서 Qwen2-VL 2B/7B 모델 [40]을 Visual-RFT와 supervised fine-tuning (SFT)으로 fine-tune함.

우리는 LISA와 동일한 test setting을 따르며, 두 방법 모두 500 fine-tuning step으로 얻은 결과를 비교함.

Tab. 5에서 보이듯, Visual-RFT는 bounding box IoU 측면에서 최종 결과를 SFT 대비 크게 향상시킴.

추가로, 우리는 Qwen2-VL이 예측한 bounding box를 SAM [11]에 prompt로 입력해 segmentation mask를 생성함 \((gIoU로 평가됨)\).

Visual-RFT는 grounding ability를 크게 향상시키며, 기존의 specialized detection system보다 더 우수한 성능을 보임.

정성적 결과는 Fig. 5에 시각화되어 있으며, 여기서 thinking process가 reasoning 능력과 grounding accuracy를 크게 향상시킴을 확인할 수 있음.

Visual-RFT를 통해, Qwen2-VL은 더 비판적으로 사고하고 이미지를 주의 깊게 살펴 정확한 grounding result를 생성하도록 학습함.

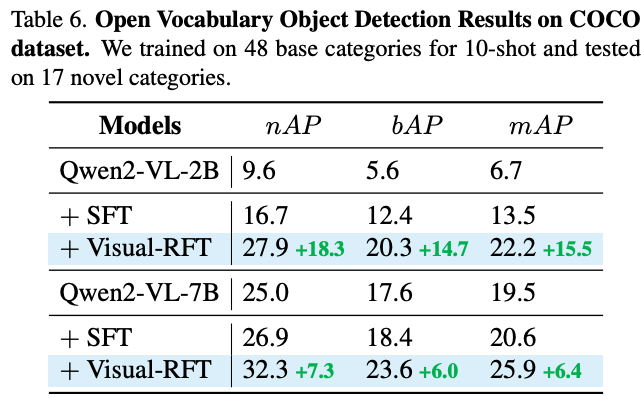

4.5. Open Vocabulary Object Detection

Visual-RFT가 SFT보다 가지는 장점은, 단순히 data를 암기하는 것이 아니라 task를 진정으로 깊이 이해한다는 점에서 비롯됨.

reinforcement fine-tuning의 강력한 generalization ability를 더 분명히 보여주기 위해, 우리는 open vocabulary object detection experiment를 수행함.

우리는 COCO dataset의 48개 base category에서 category당 10장씩 이미지를 선택하여 10-shot training set을 구성함.

이 data를 사용해 Qwen2-VL-2/7B 모델 [40]에 대해 Visual-RFT와 SFT를 수행하고, 모델이 한 번도 본 적 없는 17개의 새로운 category에서 테스트를 진행함.

Tab. 6에서 보이듯, reinforcement fine-tuning 이후 Qwen2-VL-2/7B 모델은 COCO dataset의 17개 새로운 category에서 평균 nAP가 각각 18.3, 7.3 증가함.

Visual-RFT는 COCO base category에서 학습한 detection capability를 새로운 COCO category로 transfer함.

Fig. 6에서는 nAP50을 evaluation metric으로 사용하여, Visual-RFT의 성능을 다른 여러 detection model [41, 42, 50, 53, 59]과 비교함.

Qwen2-VL-2B와 Qwen2-VL-7B 모델 모두 유의미한 향상을 보이며, 7B 모델은 10-shot setting에서 specialized model인 DE-ViT [53]를 능가함.

이는 Visual-RFT가 LVLM의 visual recognition 성능과 generalization ability를 향상시키는 데 매우 큰 영향을 미친다는 점을 보여줌.

우리는 supplementary material에서 더 광범위한 open vocabulary experiment를 수행했으며, LVIS dataset 결과도 포함되어 있음. 자세한 내용은 Sec. D.1을 참조하면 됨.

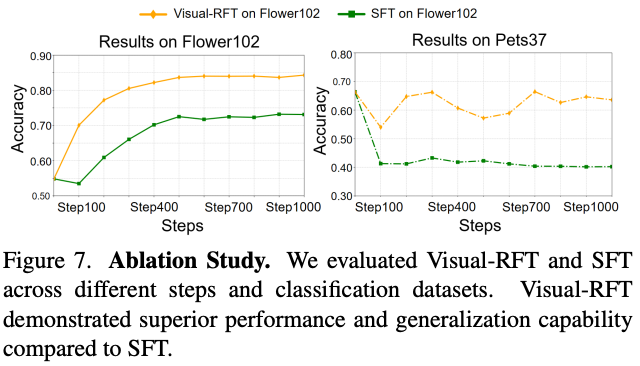

4.6. Ablation Study

SFT와 Visual-RFT의 성능 및 generalization capability를 더 비교하기 위해, 우리는 다음과 같은 ablation experiment를 수행함.

Flower102 dataset에서 2-shot setting을 사용하고, Visual-RFT와 SFT로 각각 별도의 모델을 학습시킴.

그 후 이 모델들을 Flowers와 Pets dataset 모두에서 테스트함.

서로 다른 step setting에서의 결과는 Fig. 7에 제시되어 있음.

왼쪽 차트에서는 Flowers dataset에 대한 Visual-RFT와 SFT의 accuracy가 모두 training step 수가 증가함에 따라 상승하고, 점차 saturation에 도달함.

특히 적은 양의 data를 다룰 때, Visual-RFT는 SFT에 비해 뚜렷한 이점을 보여줌.

반면 오른쪽 차트에서는 Pets dataset에 대한 SFT의 accuracy가 급격히 하락하여 baseline보다 훨씬 낮아짐.

이러한 하락은 모델이 Flower dataset으로 학습되었기 때문에 발생한 것으로, SFT의 제한적인 generalization ability를 드러냄.

반면 Visual-RFT는 Pets dataset에서도 fine-grained category를 구분하는 능력을 유지하며, training data domain과 test data domain이 다르더라도 강한 generalization 성능을 보여줌.

5. Conclusion

본 논문에서는 LVLM의 visual perception과 grounding ability를 향상시키기 위해, GRPO-based reinforcement learning 전략을 적용한 최초의 접근인 Visual Reinforcement Fine-tuning (Visual-RFT)을 제안함.

rule-based verifiable reward system을 사용함으로써, Visual-RFT는 manual labeling의 필요성을 줄이고 reward computation을 단순화하면서도, 다양한 visual perception task 전반에서 유의미한 성능 향상을 달성함.

광범위한 실험은 Visual-RFT가 fine-grained classification, open vocabulary detection, reasoning grounding, few-shot learning task에서 뛰어난 성능을 보인다는 점을 보여줌.

Visual-RFT는 극소량의 data만으로도 supervised fine-tuning (SFT)을 능가하며, 강한 generalization을 보여줌.

이 연구는 reinforcement learning이 LVLM의 capability를 강화할 잠재력을 지님을 보여주며, visual perception task에서 LVLM을 더 효율적이고 효과적으로 만들 수 있음을 시사함.

질문 모음

- What is the key difference between SFT and Visual-RFT?

- What is a verifiable reward?

- Why is RFT more data-efficient?

- Why does GRPO not need a critic model?

- Why is format reward needed?

- What is the main challenge in applying RFT to vision?

- Why does Visual-RFT generalize better than SFT?

Q1. What is the key difference between SFT and Visual-RFT?

A.

SFT는 주어진 ground-truth 정답을 그대로 따라하도록 학습하는 방식임. 즉, 입력이 들어오면 정답을 “모방(imitation)”하는 방향으로 학습됨.

반면 Visual-RFT는 정답을 직접 모방하지 않고, 모델이 여러 답을 생성한 뒤 “정답인지 여부”를 기준으로 reward를 받고, 그 reward를 최대화하도록 학습됨.

즉,

- SFT → 정답을 외우는 방식

- Visual-RFT → 여러 시도를 해보고, 맞는 방향을 강화하는 방식

그래서 Visual-RFT는 새로운 데이터에서도 더 잘 generalize됨.

Q2. What is a verifiable reward?

A.

verifiable reward는 모델의 출력이 맞는지 틀린지를 자동으로 검증해서 계산할 수 있는 reward임.

예를 들어

- classification → 정답과 같으면 1, 다르면 0

- detection → IoU 값으로 점수 계산

이처럼 사람이나 reward model 없이도, 명확한 규칙(rule)로 correctness를 판단할 수 있음.

즉,

“사람의 평가가 아니라, 정답 기준으로 직접 계산되는 reward”라고 보면 됨.

Q3. Why is RFT more data-efficient?

A.

RFT는 정답 데이터를 많이 모아서 학습하는 방식이 아니라,

모델이 여러 답을 생성하고 그 중에서 맞는 답에 보상을 주는 방식(trial-and-error)으로 학습함.

그래서 적은 데이터만 있어도

- 다양한 시도를 통해

- 점점 더 좋은 답을 학습할 수 있음

반면 SFT는 정답 데이터를 많이 필요로 하기 때문에, 데이터가 적으면 성능이 크게 떨어짐.

즉,

RFT는 “데이터 양”이 아니라 “reward signal”로 학습하기 때문에 더 효율적임.

Q4. Why does GRPO not need a critic model?

A.

기존 PPO에서는 각 답이 얼마나 좋은지를 평가하기 위해 critic model이 필요함. 즉, “이 답의 절대적인 가치”를 예측해야 함.

하지만 GRPO는 절대적인 점수를 예측하지 않고,

같은 input에서 생성된 여러 답들을 서로 비교해서 상대적인 순위만 계산함.

예를 들어

- 답 A가 B보다 낫다

- 답 C는 제일 나쁘다

이렇게 비교만으로 학습 방향을 정할 수 있기 때문에 critic model이 필요 없음.

즉,

GRPO는 “절대 평가” 대신 “상대 비교”를 사용해서 구조를 단순화한 방법임.

Q5. Why is format reward needed?

A.

format reward는 모델이 <think>와 <answer> 구조를 지키도록 강제하는 역할을 함.

이 구조가 중요한 이유는

- <think>: reasoning 과정

- <answer>: 최종 답

으로 나뉘어 있기 때문임.

이렇게 하면

- 모델이 단순히 답만 찍는 것이 아니라

- 중간 reasoning 과정을 생성하도록 유도됨

결과적으로

reasoning 능력을 학습시키고, RL에서 더 안정적으로 학습할 수 있게 해줌.

Q6. What is the main challenge in applying RFT to vision?

A.

vision task에서는 “정답을 어떻게 정의하고 reward로 계산할 것인지”가 가장 큰 문제임.

예를 들어

- classification → 쉬움 (정답 비교)

- detection → IoU 필요

- grounding → 위치 정확도 필요

즉, language처럼 단순히 정답이 하나 있는 게 아니라,

정답의 형태가 다양하고 연속적 값(예: 위치, 영역 등)이기 때문에 reward 설계가 어려움.

그래서 이 논문의 핵심 기여 중 하나가

visual task마다 verifiable reward를 설계한 것임.

Q7. Why does Visual-RFT generalize better than SFT?

A.

SFT는 training data의 정답을 그대로 학습하기 때문에,

보지 못한 데이터에서는 쉽게 overfitting 문제가 발생함.

반면 Visual-RFT는

- 여러 답을 생성하고

- reward를 통해 올바른 방향을 학습함

즉, 단순히 정답을 외우는 것이 아니라

“왜 맞는지”를 학습하게 됨.

이 과정에서

- reasoning 능력이 강화되고

- 새로운 데이터에서도 더 잘 동작함

그래서 Visual-RFT는 SFT보다 generalization 성능이 더 좋음.